破局困境·架构解密

新华三打造智算推理新引擎

当前,大模型推理面临的发展困境已不可回避:模型对算力与显存的需求呈指数级增长,然而堆叠GPU硬件所带来的成本与能效压力,严重制约技术的可持续发展。尤其在处理长文本、多轮对话等场景时,模型为保存上下文而生成的KV Cache(键值缓存)会急剧膨胀,不仅大量占用宝贵的GPU显存,更导致大量重复计算,成为制约响应速度、推高运营成本的瓶颈。

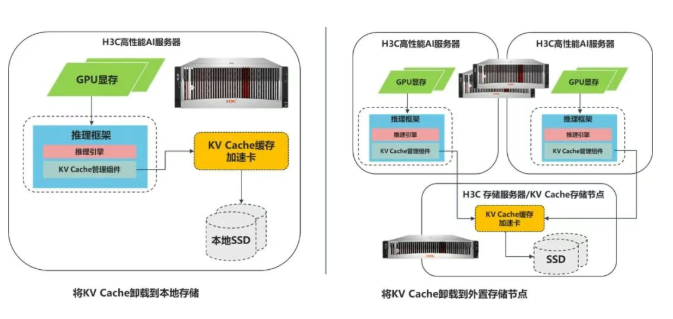

直面成本与效率的核心痛点,紫光股份旗下新华三集团打造出效能兼备的大模型推理场景加速方案。通过ASIC芯片提供硬件级加速,将KV Cache从GPU内存卸载到指定存储节点,构建专为AI设计的“下一代内存层”,减轻GPU显存的压力,从而在系统层面实现了存算资源的新平衡。新华三凭借自身强大的硬件集成与全栈优化能力,驱动业内前沿科技与自研AI服务器的创新耦合,经过深度的测试调优最终形成了大模型推理加速的最佳实践,为业界提供了一条性能与成本兼顾的全新推理范式。

从部署形态来看,本方案既支持单机形态部署,直接提高单台AI服务器的推理性能。也支持通过外置存储节点的方式同时对接多台AI服务器,提高集群的推理性能。

实测验证·性能跃升

核心指标翻倍,推升深度推理新速度

为深入探究本方案中KV Cache卸载对推理性能的提升,新华三基于自研高性能AI服务器进行基准测试,重点关注在同一机型上,运行DeepSeek-V3-671B模型时,采用标准推理服务和采用KV Cache卸载加速方案的两种模式下的性能差异,分别构建10K和30K的文本输入,模拟实际应用场景中的多轮对话推理过程,以确保测试结果具有实际参考价值。经多轮验证,采用KV Cache卸载加速方案的推理核心指标显著优化:

• 并发用户数提升200%:在相同TPOT(每个Token生成的平均延迟,ms)限制下,同样的算力资源可支持的并发数显著提升,保障用户体验的同时支持服务更多的用户。

• 推理延迟大幅降低:TTFT(首Token生成的延迟,ms)降低70%,TPOT(每个Token生成的平均延迟,ms)降低30%,大幅缩短响应延迟,提升用户体验。

场景适配·全域覆盖

贴合企业GenAI落地需求

• 交互式应用(多轮对话): 如聊天机器人、智能客服等。这类应用中,用户与模型的交互是多轮的,后续轮次的输入通常依赖于前序对话的上下文。通过快速加载存储历史 KV Cache,能够大幅缩短响应延迟,提升用户体验。

• 长上下文处理: 对于需要处理数千甚至数万Tokens上下文的任务(如长文档问答、代码生成、复杂指令理解),GPU内存容量往往成为瓶颈。本方案提供的PB级KV Cache扩展能力,使得处理这类长上下文任务更为从容,避免了因GPU内存不足导致的性能下降或任务失败。

• 高并发推理服务: 在面向大量用户的在线推理服务中,系统需要同时处理多个并发请求。本方案通过高效的KV Cache管理,能够支持更多并发会话,显著提高系统的整体吞吐量(RPS),从而在相同的GPU资源下服务更多用户。

成都强川科技有限公司,专注企业IT服务需求,产品可按需定制。主营:华三服务器、H3C服务器、,以专业的IT解决方案和优质的服务体验赢得企业信赖。QQ:2851150694;服务热线:028-85024766 18215624006(微信同号

H3C 是中国一家 IT 设备供应商,包括 HPE 服务器、存储和相关技术服务。它由 HPE 持有 49% 的股份,其余由总部位于中国的 IT 服务公司 Unisplendour Corporation 持有,此前 HPE 在 2015 年以约 23 亿美元的价格出售了它的控股权。

具有算力强、可靠性高、灵活扩展性强、易管理,易部署等优点,可广泛应用于虚拟化、云计算、高性能计算,人工智能等场景。

全新一代H3C UniServer R4900 G5通过多达32个NVMe SSD1的支持,以及M.2 SSD形态的引入,进一步增强了面向现代数据中心的扩展能力和配置灵活性。

可广泛应用于互联网、云计算、IDC(Internet Data Center,互联网数据中心)、企业市场、运营商等场景,R4950 G5具有低功耗、高可靠、灵活扩展性强、易管理,易部署等优点。

H3C UniServer R4700 G5,新华三集团自主研发的全新一代高性能1U2路机架式服务器,以卓越的性能和完美的可扩展性满足市场的需求。

H3C UniServer R4900 G3,通用型2U双路机架式服务器,面向不同业务负载平衡性能、扩展力及安全可靠等特性,显著提升数据中心生产力。

新华三H3C UniServer R4700 G3,高性能1U2路机架式服务器,满足数据中心对性能、能效和密度之间平衡的严苛要求,是高密度工作负载的理想选择。

新华三H3C UniServer R2900 G3,可满足轻量级业务部署需求的入门级2U双路机架服务器,凭借灵活弹性的配置保护企业IT投资

新华三H3C UniServer R2700 G3,入门级1U2路机架式服务器,满足成长型客户对主机性能以及经济性合理平衡的要求。

具有计算性能高、存储容量大、扩展性强和可靠性高等特点,在HDM、iFIST、FIST服务器管理系统的加持下,具有易于管理和便于部署的优点。

具有计算性能高、存储容量大、扩展性强和可靠性高等特点,在HDM、iFIST、FIST服务器管理系统的加持下,具有易于管理和便于部署的优点。

H3C UniServer R6700 G3,4P2U机架服务器,采用高密度架构设计,提供4路高性能计算能力,在2U机箱内实现高度的可伸缩性和可靠性。

该产品具有卓越性能、重塑架构、扩展性强和可靠性高等特点,可应用于深度学习模型训练、深度学习推理、高性能计算、数据分析等多种应用场景

该产品具有计算性能高、存储容量大、扩展性强和可靠性高等特点,易于管理和部署,可应用于深度学习模型训练、深度学习推理、高性能计算、数据分析等多种应用场景。

H3C UniServer R5500 G5支持全新的多实例GPU特性,可将单颗GPU最多分割成7个GPU实例,每个GPU实例可运行不同应用,极大提升了GPU的资源利用率。

H3C UniServer R5300 G3是面向人工智能和高性能计算领域自主研发的全新一代GPU服务器,可以加速深度学习模型建造,以极快速度分析数据并导出有价值信息。